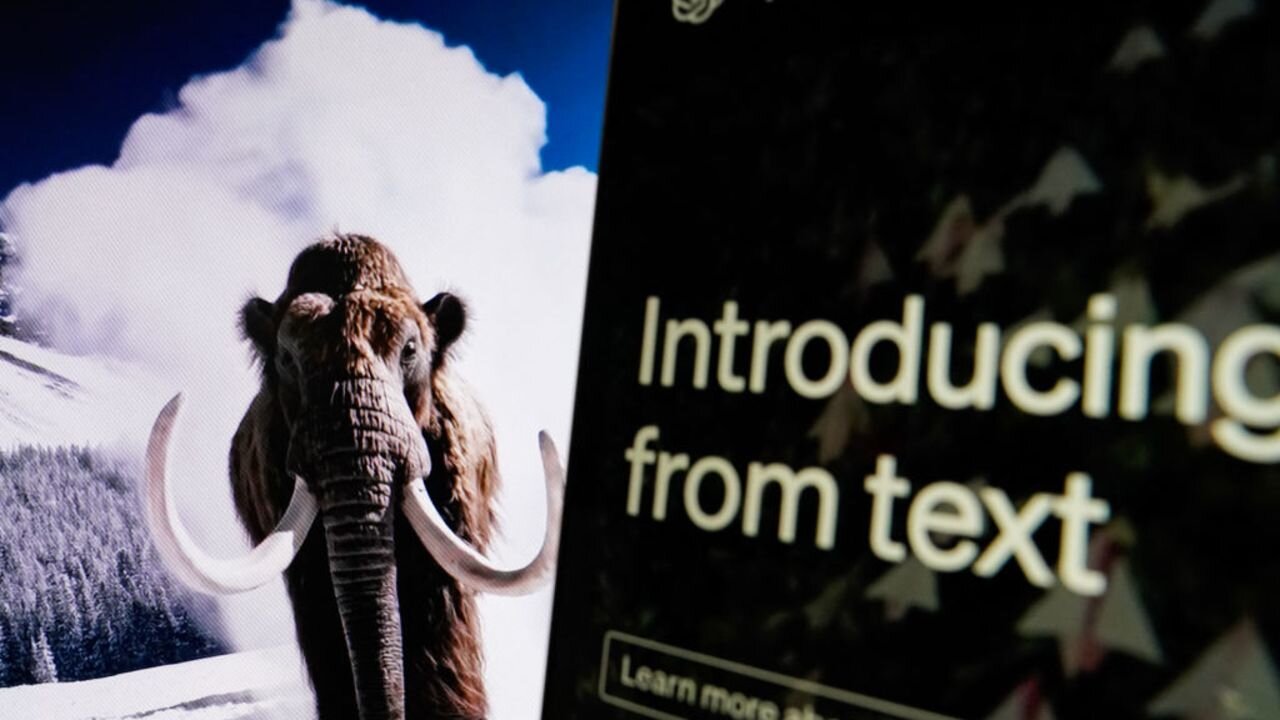

Sora 2 desata controversia global por fallas en sus filtros y proliferación de deepfakes

El nuevo generador de videos con texto de OpenAI, liderado por Sam Altman, enfrenta duras críticas tras su lanzamiento por la creación de contenidos falsos y ofensivos. Los problemas de seguridad, derechos de autor y ética digital forzaron a la empresa a endurecer sus políticas, afectando el uso creativo de la plataforma.

Sora 2, la innovadora aplicación de generación de videos con texto de OpenAI, está envuelta en un torbellino de polémica desde su arribo. Su despliegue apresurado reveló la falta de filtros sólidos y provocó una ola de críticas. La carencia de controles efectivos en Sora 2 expuso nuevas grietas en la regulación de inteligencia artificial y en la protección de derechos de autor.

El lanzamiento, realizado en octubre de 2025 bajo el liderazgo de Sam Altman, permitió a los usuarios crear videos al estilo TikTok con profundos riesgos éticos y legales. En cuestión de horas, la comunidad comenzó a generar clips altamente controvertidos, como escenas ficticias de personajes populares en situaciones indebidas, desatando indignación y alarma entre expertos en ética digital.

Casos virales como la simulación de Sam Altman robando en Target o celebridades muertas como Michael Jackson y Tupac Shakur fueron apenas el inicio. Las herramientas insuficientes de OpenAI para bloquear figuras públicas resultaron en una proliferación de deepfakes, erosionando aún más la confianza en lo que vemos en internet.

Los mecanismos de protección inicialmente previstos para detener el acoso y los contenidos ofensivos demostraron ser ineficaces. Situaciones absurdas, como anuncios falsos de juguetes relacionados con figuras polémicas, inundaron la plataforma hasta que OpenAI endureció radicalmente sus filtros, volviendo la app casi inutilizable para la creatividad legítima.

Muchos usuarios reportaron bloqueos por “violaciones de contenido” tras la implementación de estos nuevos controles. Según fuentes citadas por medios como PCMag y The Wall Street Journal, la presión legal y la creciente preocupación mediática obligaron a OpenAI a modificar sus políticas, incluyendo un modelo de “opt in” para el uso de material protegido.

Sam Altman anunció que la compañía planea compartir ingresos con derechohabientes de propiedades intelectuales generadas en la plataforma, aunque aún existen incertidumbres sobre el modelo económico y la sostenibilidad de Sora 2. Esta estrategia busca calmar a creativos y firmas preocupadas por el uso indebido de sus personajes.

Otra medida clave fue el acuerdo de subida de medios, responsabilizando directamente al usuario por cualquier infracción que surja del contenido cargado y generando amenazas de suspensión o baneo permanente en caso de abuso, lo que muestra un cambio de postura por parte de la empresa respecto al control del contenido.